Neuronale Netze, die Text in Bilder umwandeln, haben in kurzer Zeit enorm an Popularität gewonnen. Noch vor nicht allzu langer Zeit erzeugten sie nur unscharfe, abstrakte Bilder, die nur entfernt an das erinnerten, was von ihnen verlangt wurde. Heute können die Ergebnisse der Generierung versehentlich mit echten Fotos verwechselt werden.

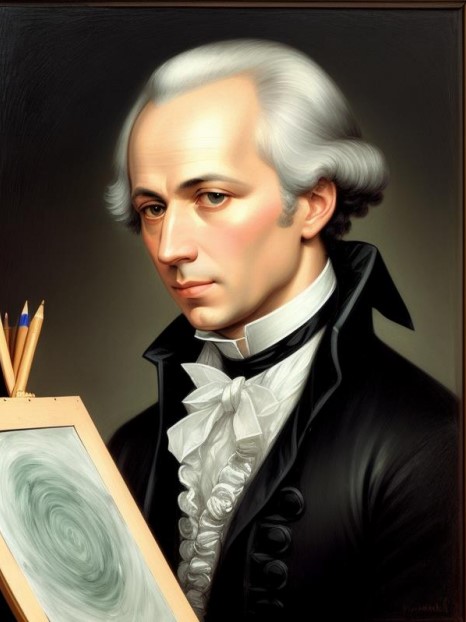

Neuronale Netze wie Stable Diffusion, Midjourney und DALL-E 2 sind in der Lage, in den Händen eines geschickten Anwenders jede Fantasie zu visualisieren. Im Rahmen des Projekts «Kant als Künstler», das anlässlich des bevorstehenden 300. Geburtstags von Immanuel Kant durchgeführt wird, haben die Mitarbeiter des Zentrums für Neurotechnologien und Maschinelles Lernen an der Baltischen Föderalen Immanuel Kant-Universität beschlossen, sich vorzustellen, welche Art von Bildern der Philosoph gemalt haben könnte, wenn er ein Künstler wäre.

Der Pressedienst erfuhr von den Mitarbeitern des Zentrums, Gleb Kamyschov und Wladimir Savin, mehr darüber, wie solche «Neuro-Netze» aufgebaut sind und wie man mit ihnen arbeitet, um das erforderliche Ergebnis zu erzielen.

— Wofür steht das Projekt «Kant als Künstler» in dieser Phase?

|

Wladimir Savinov, Juniorforscher am Zentrum für Neurotechnologien und maschinelles Lernen: |

|

— Es gibt eine solche Software — Stable Diffusion (SB). Dabei handelt es sich um ein trainiertes neuronales Netz, das einen Text als Ausgangspunkt nimmt und auf der Grundlage dieser Anfrage ein Bild erzeugt. Unser Modell funktioniert auf seiner Grundlage. |

— Wodurch unterscheidet es sich von Midjourney, DALL-E 2 (und anderen berühmten neuronalen Netzwerken vom Typ Text-zu-Bild)?

— Das ist im Grunde genommen das Gleiche. Nur als eine Alternative.

— Haben Sie vor, das Projekt öffentlich zugänglich zu machen?

— Der Trick ist, dass wir die Standardlösungen übernommen haben. Sie sind bereits verfügbar. Sie können die Modelle* für Stable Diffusion nehmen und kostenlos verwenden. Und für die Generierung kann man eine Web-Schnittstelle von GitHub (dem größten Hosting-Dienst für IT-Projekte) herunterladen. Wir betreiben es auf unserem eigenen Server.

*Modelle sind Steuerdateien, die vortrainierte neuronale Verbindungen darstellen. Sie sind darauf ausgelegt, bestimmte Bilder zu erzeugen. So kann es sich beispielsweise um ein Modell handeln, das besser für die Erzeugung von Bildern von Tieren geeignet ist.

— Wir hatten eine Idee: «Was für Bilder würde Immanuel Kant malen, wenn er ein Maler wäre? Wir begannen damit, seine beliebtesten Zitate als Eingabeaufforderung* (Prompt) zu nehmen und sie in das Stable Diffusion-Model einzugeben. Vielleicht ist es zu erwarten, aber das neuronale Netz begann, so etwas wie Motivationsposter zu erzeugen: ein Bild und etwas Pseudotext darüber (in der Regel sind neuronale Netze noch nicht in der Lage, Text in ein Bild zu integrieren. Beispiel unten). Das hat uns nicht befriedigt.

*Prompt ist eine Eingabeaufforderung, die das neuronale Netz zur Erstellung des Bildes verwendet.

|

Gleb Kamyschov, Juniorforscher am Zentrum für Neurotechnologien und maschinelles Lernen: |

|

— Dann wandten wir uns einem anderen neuronalen Netz zu — ChatGPT. Wir haben es gefragt: «Was sind die Hauptthesen in Kants Philosophie?». Es schrieb über a priori Wissen, den kategorischen Imperativ..... Dann fragten wir: «Was hätte Kant gezeichnet, wenn er ein Künstler wäre?». Sie sagte, man wisse nicht genau, was er gezeichnet hätte. Aber der empirische Imperativ kann als ein Lichtstrahl oder ein Suchscheinwerfer dargestellt werden.... ChatGPT half uns also bei der Auswahl der Prompts, die wir in das SD-Modell einspeisten. |

Wladimir Savinov:

— Es ist nicht trivial, die richtigen Prompts auszuwählen. Manchmal muss man viel Zeit aufwenden, um von einem neuronalen Netz das zu bekommen, was man will. Deshalb ist das Prompt-Engineering eine separate Disziplin, die sich mit der Auswahl und der Arbeit mit Modellen befasst.

Gleb Kamyschov erzählte darüber, wie man Anfragen für neuronale Netze eingibt.

— Die Betonung liegt vor allem auf «Tokens*». Jedes Wort ist jedes Token. In den Stable Diffusion-Modellen ist ein Wort umso wichtiger, je weiter links es steht. Dabei ist zu berücksichtigen, dass das Wort nach dem Komma alle anderen Wörter beeinflusst und sie in ihrer Bedeutung überdeckt. Daher müssen manchmal Tokens wiederholt werden, damit sie sich nicht überschneiden. So können Sie durch das Jonglieren mit den Zeichen und dem Grad ihrer Bedeutung das gewünschte Ergebnis erzielen.

*Token ist eine separate semantische Einheit innerhalb einer Eingabeaufforderung (Prompt).

Jedes neuronale Netz hat seine eigene Syntax, da sein Code in einer der Programmiersprachen geschrieben wird. Wenn Sie versucht haben, Bilder zu erzeugen, haben Sie vielleicht festgestellt, dass die Bilder, die Sie erhalten, nicht so gut sind wie die, die Sie im Internet gesehen haben. Höchstwahrscheinlich liegt das Problem an der Syntax.

Wenn man die Syntax eines neuronalen Netzes kennt, kann man mit ihm die gleiche Sprache sprechen und leichter erklären, was man braucht. Das wichtigste Syntaxelement von Stable Diffusion sind zum Beispiel verschiedene Arten von Klammern: (), []. Sie ermöglichen es, die Bedeutung eines Tokens entweder zu erhöhen oder zu verringern.

Wladimir Savinov:

— SD-Modelle haben eine weitere negative Eingabeaufforderung. Es gibt einen Befehl, der als Ergebnis nicht benötigt wird.

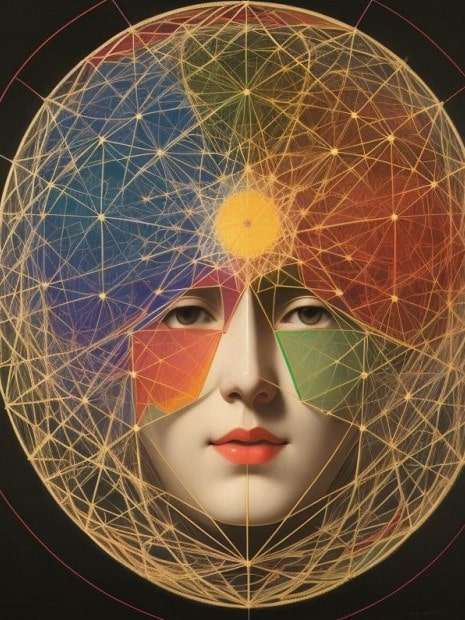

Suchanfrage: «Mensch, Interaktion zwischen mathematischen Wahrheiten und Sinneserfahrungen, komplizierte Details, Künstlerstil des 18. Jahrhunderts, detailliert, Philosophie, abstrakt, Modernismus».

Bei der Suche ausschließen (negative Eingabeaufforderung): deformiert, verzerrt, verstümmelt, schlecht gezeichnet, anatomisch falsch, zusätzliches Glied, fehlendes Glied, wanderndes Glied, mutierte Hände und Finger, abgetrennte Gliedmaßen, Mutation, mutiert, hässlich, ekelhaft, verschwommen, Amputation, verschwommene Gesichter.

— Wie lange müssen Sie an einer Suchanfrage arbeiten, um zu bekommen, was Sie wollen?

Gleb Kamyschov:

Wladimir Savinov:

— Weil all diese neuronalen Netze auf unterschiedlichen Datensätzen trainiert werden. Sie werden mit einer Reihe von Bildern «gefüttert», damit sie auf dieser Grundlage Bilder erzeugen können.

— Sie haben es also nicht selbst trainiert?

— Nein, man braucht eine Menge Bilder und eine Menge Rechenkapazität, um Modelle zu trainieren. Wir haben unsere eigenen, aber wir brauchen viel mehr für das Training. Deshalb haben wir ein fertiges Instrumentarium genommen, das SD-Modell. Wir haben bereits mit einem anderen Modell gearbeitet, aber die Ergebnisse gefielen uns nicht besonders gut. Denn die Generierung hängt nicht nur von den Tokens ab, sondern auch vom Modell selbst. Wir haben ein anderes heruntergeladen, und das hat viel besser funktioniert. Vor allem was die Anatomie des Körpers angeht. Und es hat auch alles bunter gezeichnet.

— Welche Entwicklungsperspektiven sehen Sie für dieses Projekt?

— Der letzte Punkt ist die Erstellung einer Webschnittstelle. Dabei handelt es sich um eine Bildergalerie, in der der Benutzer das erzeugte Bild sehen und herausfinden kann, aus welcher Textanfrage es entnommen wurde.

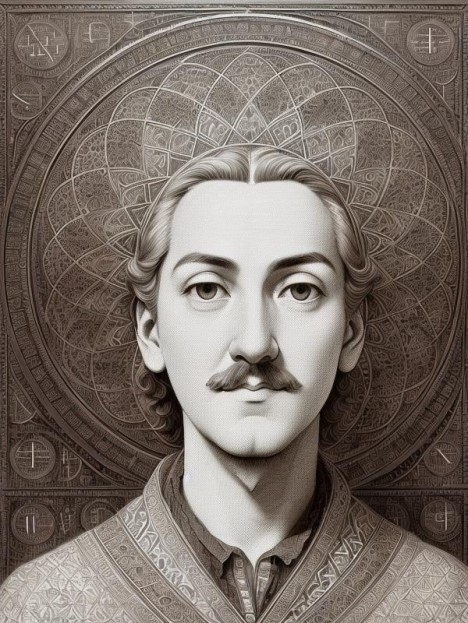

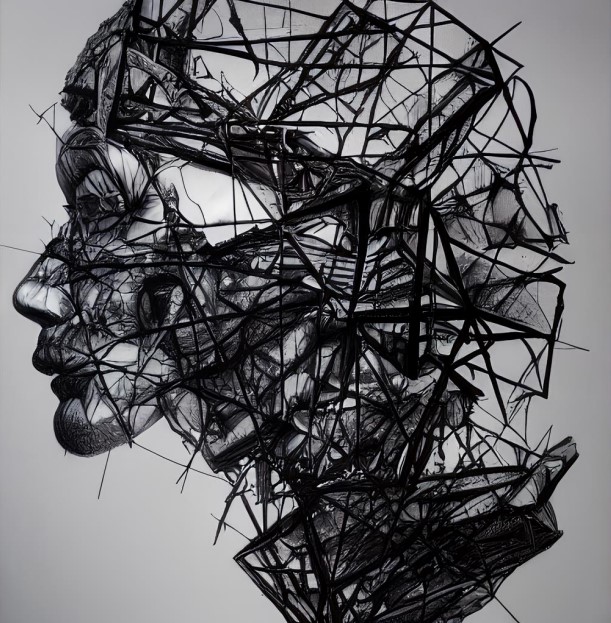

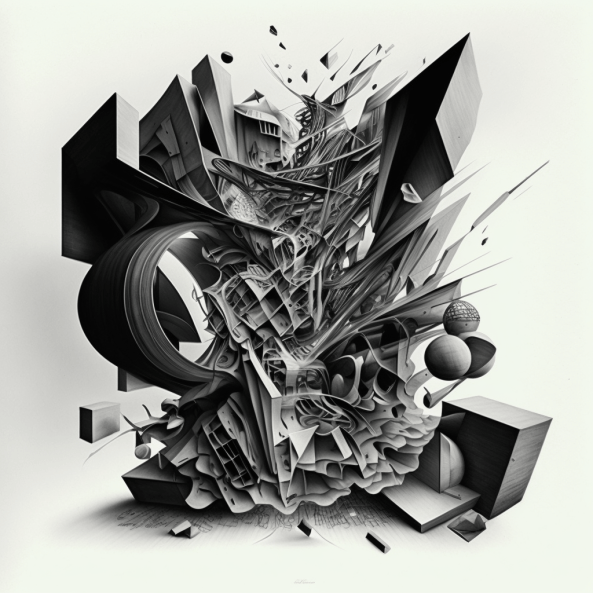

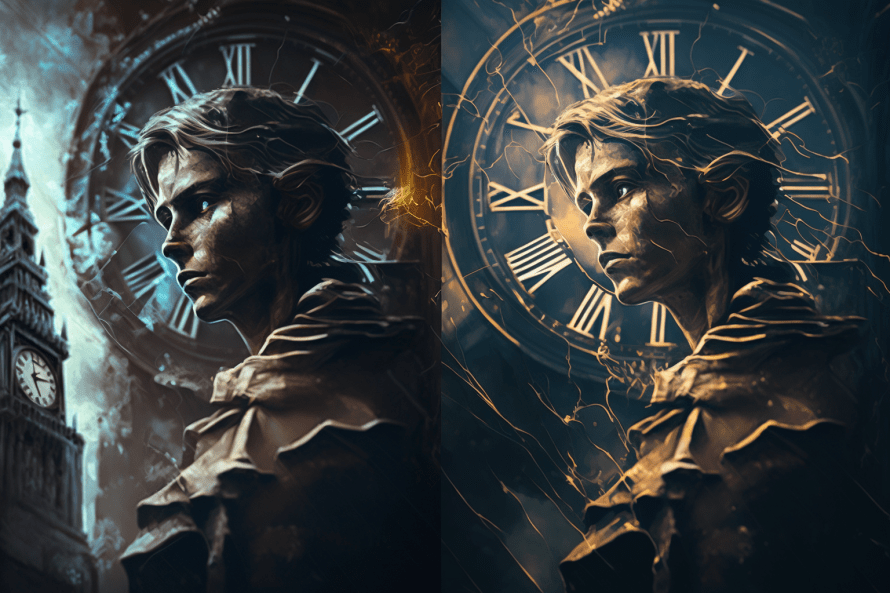

Schließlich haben wir beschlossen, Bilder mit denselben Anfragen wie die Mitarbeiter des Zentrums für Neurotechnologien und maschinelles Lernen zu erzeugen, aber mit einem anderen neuronalen Netz, Midjourney (SD links, Mj- rechts).

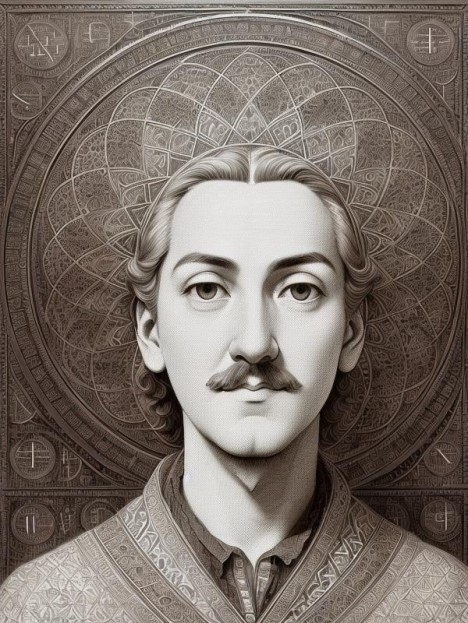

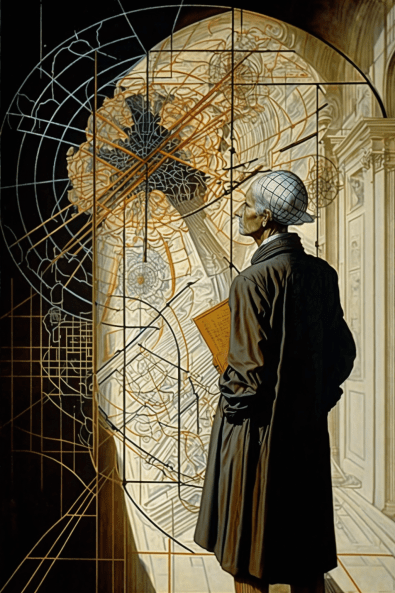

Eine atemberaubende Zeichnung des Zusammenspiels zwischen dem Materiellen und dem Abstrakten in einem philosophischen Sinne. Dekonstruktion, hohe Detailgenauigkeit, Tiefe, viele Details, Lumen-Rendering, 8K.

|

|

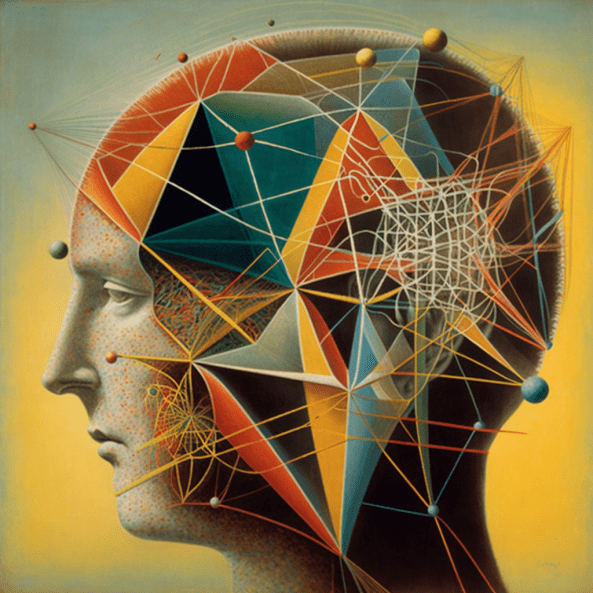

Der Kopf ist ein komplexes Netz miteinander verbundener Knotenpunkte, in dem verschiedene Arten von Wissen durch unterschiedliche Farben oder Teile des Gehirns dargestellt werden. Abstraktion, im Stil eines Künstlers des 18. Jahrhunderts, detailliert, Philosophie, Abstraktion, Modernismus.

|

|

|

|

|

|

|

|

|

|

|

|

Autor: Michail Stepanov